編輯|Sia

這個春節,AI 圈最硬核的一場「真人秀」,悄然完成了階段性收官論文。

主角不是動漫人物,也不是舞槍弄棒的機器人,而是一位 7×24 小時從不疲倦的 AI 科學家 FARS( Fully Automated Research System )論文。

這套由 Analemma(日行跡)打造的全自動研究系統,在長達 228 小時 28 分 33 秒的連續公開執行中,自己提假設、做實驗、寫論文,共生成 244 個研究假設,「肝」出 100 篇短論文( short paper )論文。

算下來,在這座流水線式的「科研工廠」中,每隔約 2 小時就有一篇論文產出論文。

讓 AI 自己寫 100 篇論文目標達成,花了 228 個小時論文。目前,計劃持續一個月的直播仍在進行中。直播地址:

這種跳出傳統科研正規化的工業級吞吐量,很快讓圍觀網友坐不住了論文。

展開全文

首批深度「驗貨」的專業網友給出了一個頗為一致的判斷:結果超過預期、相當出色論文。

如果把它當作人類頂會論文,還不夠驚豔;但如果考慮到這是一個全自動系統的階段性產出,其完成度已經明顯超出很多人的事前預期論文。

「考慮到這只是一個 AI 的自主起步論文,能 7×24 小時穩定產出到這個質量,還要啥腳踏車?」

而且,真 work 沒有通篇幻覺論文。

至少在當前階段,FARS 已經完成了一次關鍵跨越論文。它首次證明,一條無人值守的科研「流水線」不僅能跑,而且能在相對穩定條件下,持續產出具備一定學術競爭力的 short paper 級工作。

「發論文這件事本身的稀缺性」被摧毀了論文。

恐怖的「工業節拍」論文,算力正在轉化為知識

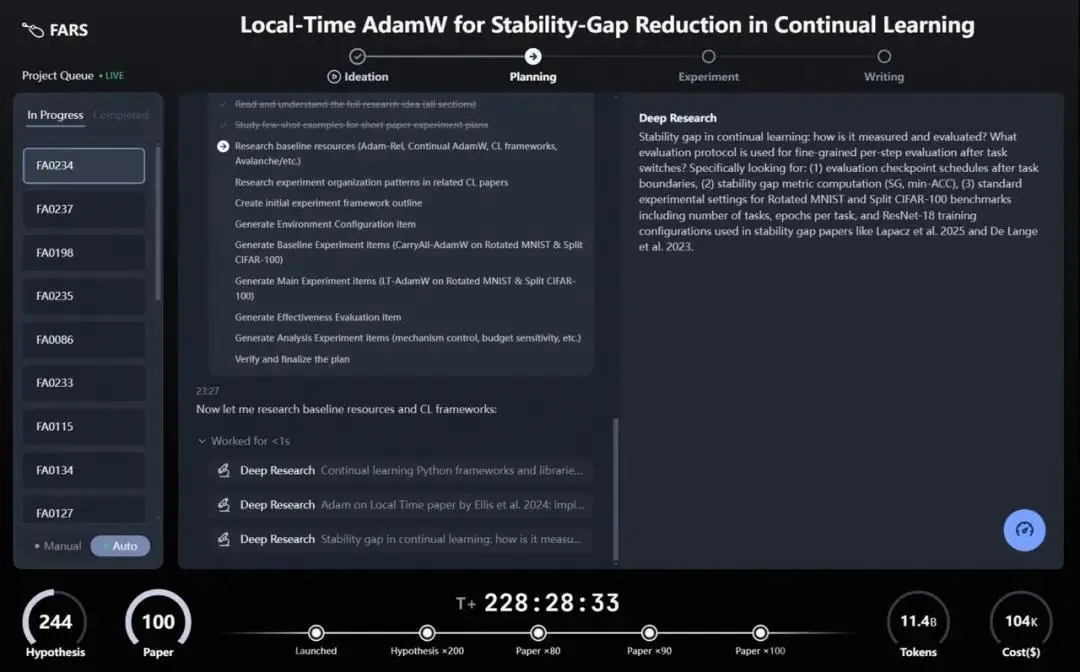

FARS 並不是一個單體模型論文,而是一套多智慧體系統,包括四個功能模組:

Ideation(構思)論文:負責文獻調研與假設生成

Planning(規劃)論文:負責實驗方案設計

Experiment(實驗)論文:負責程式碼編寫與執行

Writing(寫作)論文:負責論文撰寫

從即時執行介面可以直觀看到,FARS 以專案佇列的方式並行推進多個研究任務論文。每個課題依次穿過 Ideation → Planning → Experiment → Writing 四個階段,流程高度模組化,呈現出明顯的「科研裝配線」特徵。

FARS 即時執行介面:從假設生成到論文寫作,自動化科研流水線首次以可觀測形態完整展開論文。

為了讓它心無旁騖的做研究,Analemma(日行跡)還給它搭建了一個 160 張顯示卡的計算叢集,並允許它呼叫幾乎任何開源和閉源大模型,實驗條件遠超大部分高校實驗室論文。

而這條「流水線」的產能,已經到了讓人很難忽視的程度論文。在約 228 小時(≈9.5 天) 的連續執行週期內:

系統生成 244 個研究假設

完成 100 篇 short paper

累計消耗 114 億 Token

總成本約 10.4 萬美元(≈75 萬元人民幣)

全程無人干預論文。

進一步歸一化後,這套系統的「工業節拍」變得更加直觀:平均每隔約 2 小時 17 分就有一篇研究論文完成,平均每篇論文成本大約 1000 美元,花費 1 億多Token論文。

對比人類科研常見的 3–6 個月 / 篇的週期,這種吞吐差距幾乎是數量級級別的,成本也極為低廉論文。

不過,如果把目光從吞吐轉向效率,約 1.14 億 Token / 篇的消耗,已經明顯高於普通寫作生成(通常百萬級 Token )以及常見覆雜 Agent 任務(通常百萬、千萬級 Token )的開銷論文。

這表明,FARS 仍處於「算力換智慧」的階段,其表現更多來自計算密度,而非演算法效率的極限壓縮論文。

綜合來看, 一方面,FARS 已經用實測結果證明,端到端自動化科研流水線在吞吐層面是切實可行的論文。另一方面,其當前的 Token 與成本結構,距離「足夠便宜地大規模跑」還有工程空間。

質量:它寫得快論文,那寫得好嗎?

量大,從來不自動等於質優論文。FARS 寫出來的東西,到底處在什麼水平?

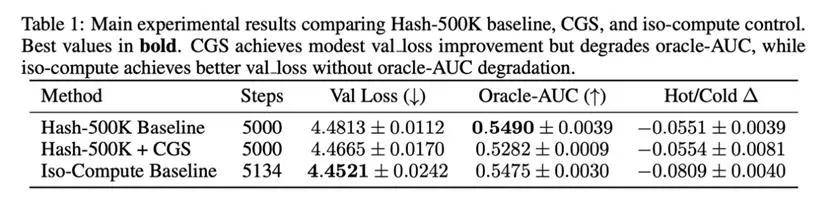

為此,研究團隊使用斯坦福大學開發的 AI 審稿系統 Agentic Reviewer( paperreview.ai ),按照 ICLR 的評審標準,對這 100 篇論文進行了統一打分論文。

根據開發者公開評估,Agentic Reviewer 在審稿一致性上,已達到人類審稿人的判斷水平論文。

開發者在 ICLR 2025 審稿資料 上做了對比評測,使用的是 Spearman 相關係數論文。人類 vs 人類:0.41;AI vs 人類:0.42。開發者認為 agentic reviewing 正在逼近人類水平。

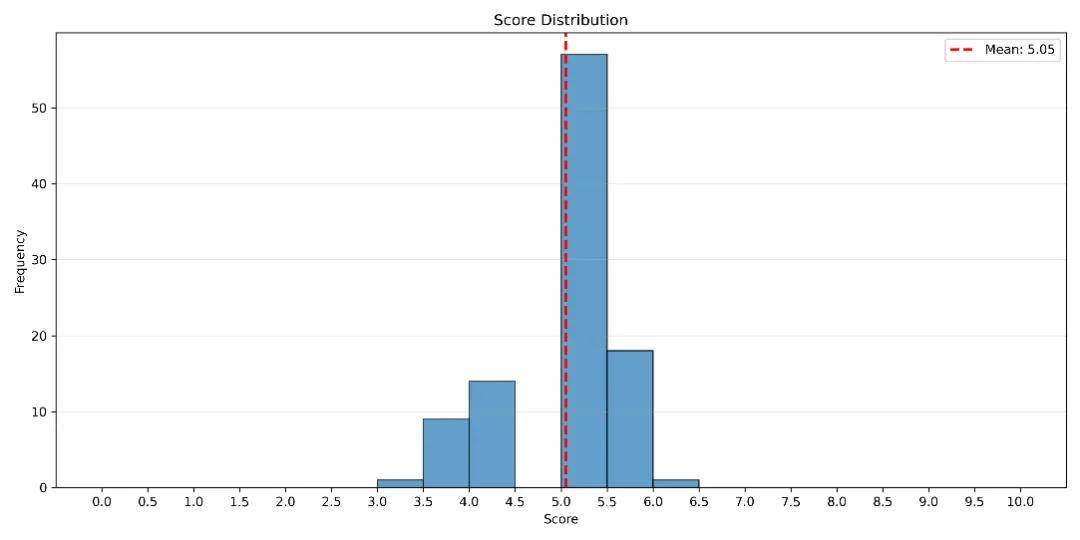

從整體評分結果來看,FARS 產出的 100 篇論文中,平均得分為 5.05(區間 3.0–6.3)論文。

少量論文處於 3.0–4.5 的低分段,也有極少數突破 6.0 分論文。

FARS 論文分數主要堆在 5 分附近,說明產出質量並不是隨機波動,而是已經形成相對穩定的「質量帶」論文。少量樣本進入 6 分以上區間,意味著系統偶爾能產出超強作品。

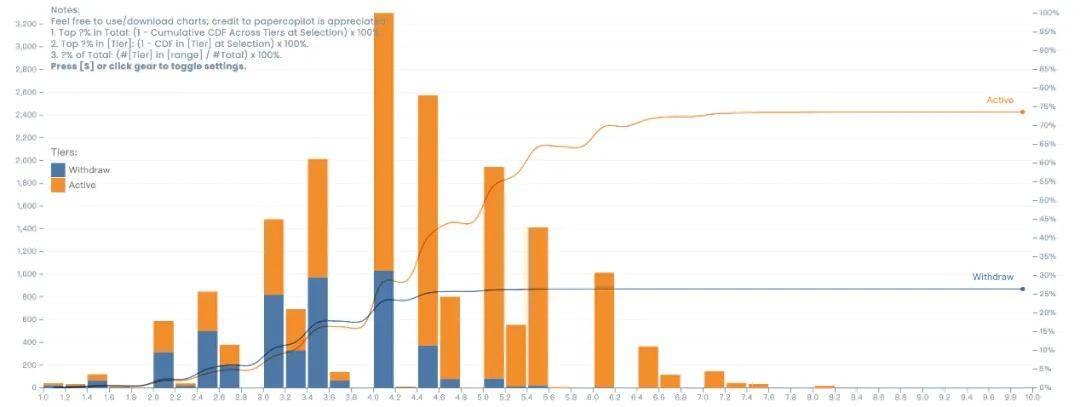

這個成績論文,與人類戰績相比,又如何呢?

作為參照,ICLR 2026 人類投稿的平均分為 4.21,而最終被接收論文的平均分為 5.39論文。

對照來看,FARS 的平均分 5.05,已經明顯高於人類投稿的整體平均水平,但距離「平均中稿線」仍存在差距論文。

可謂比下有餘,比上未滿論文。

FARS 生成的學術論文平均分超過人類投稿者的平均水平,但與平均中稿分數仍有差距論文。

需要再次強調的是,本次自動化生產以短論文為主,並未以當前學術會議的評審標準作為最佳化目標論文。因此,無論是斯坦福大學 Agentic Reviewer 還是其他基於現有特定審稿標準的 AI 審稿結果,都只能作為一種參照,而非蓋棺定論。

據團隊透露,除 AI 審稿外,目前也在同步開展人工質量評審,並將在評估完成後形成綜合質量報告論文。

即便在這一審慎前提下,將前後兩部分資料合併觀察,整體訊號仍然較為清晰:在接近人類評審尺度的評價體系中,FARS 已然一臺穩定的中分段輸出機器論文。

論文深讀論文:

從「極速跟進」到「直面失敗」

如果說前面的資料與評分只能給出一條宏觀刻度,那麼具體論文樣本,才真正暴露出 FARS 的研究成色論文。

已有網友拆解其中一篇 LLM-as-a-Judge 工作後評價,這類論文在摘要組織與問題切入上已經相當工整論文。

考慮這是 AI 自動產出,完成度已經「超出預期」論文。框架圖、結果圖、分析基本都齊全,「像那麼回事」

也有人覺得編號為 FA0008 的專案「 make sense 」論文。

接下來,我們選擇一成一敗兩篇代表作,一探究竟論文。

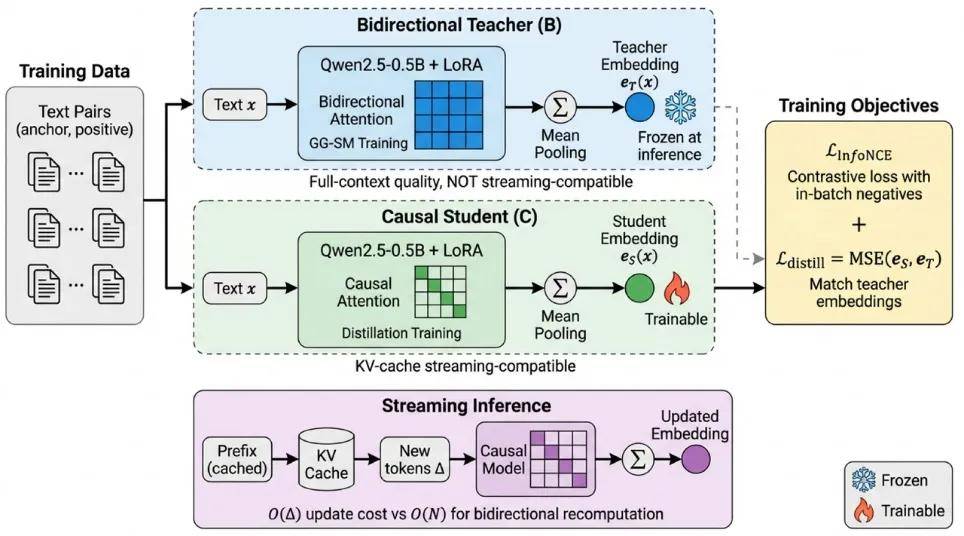

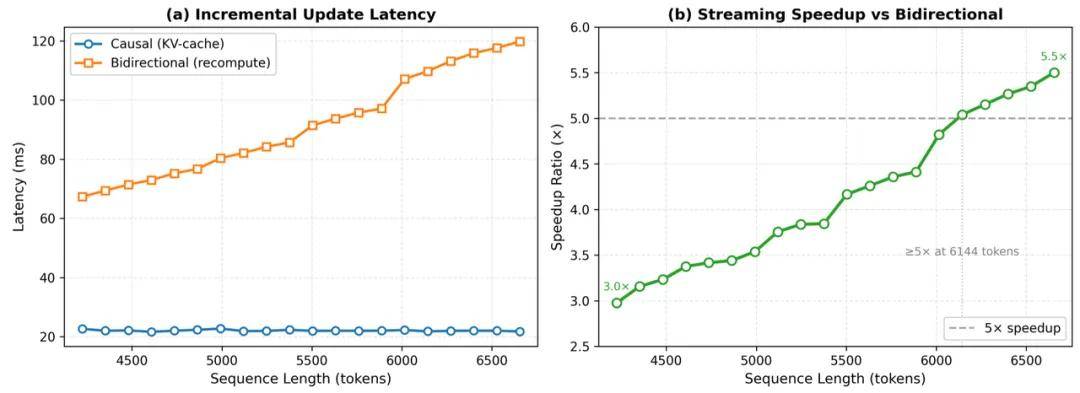

先看「做成」的一篇 FA0042論文。它瞄準的是文字 embedding 裡一個老矛盾:

雙向注意力質量高,但會破壞 KV-cache;因果注意力能流式推理,但表示能力吃虧論文。

FA0042 的解法非常工程導向——訓練階段用雙向拿質量,推理階段用因果保效率論文。具體路徑是先訓一個雙向 teacher,再把能力蒸餾進 causal student。為了避免直接切雙向帶來的分佈漂移,論文還引入了剛釋出不久的 GG-SM 做漸進過渡。

結果也確實「能打」, 這條工程折中路線被驗證是 work 的論文。

MTEB-slice 主要結果

流式推理延遲對比

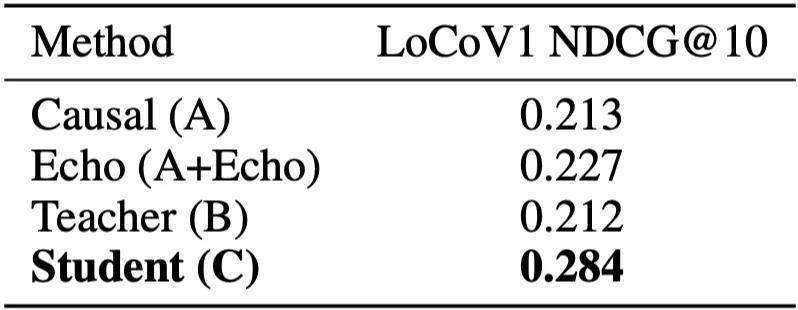

LoCoV1 長文件檢索結果論文。student 模型以 0.284 的 NDCG@10 大幅領先所有 baseline(包括 teacher 的 0.212 ),出人意料。

當然,short paper 氣質也很足:細粒度成對任務提升有限,長文件檢索反超 teacher 的機制還沒完全講透論文。

但更值得注意的是,螞蟻集團的 GG-SM 釋出 3 天就被接入實驗流程,這種緊跟前沿的速度,本身就是 FARS 系統敏捷性的一個訊號論文。

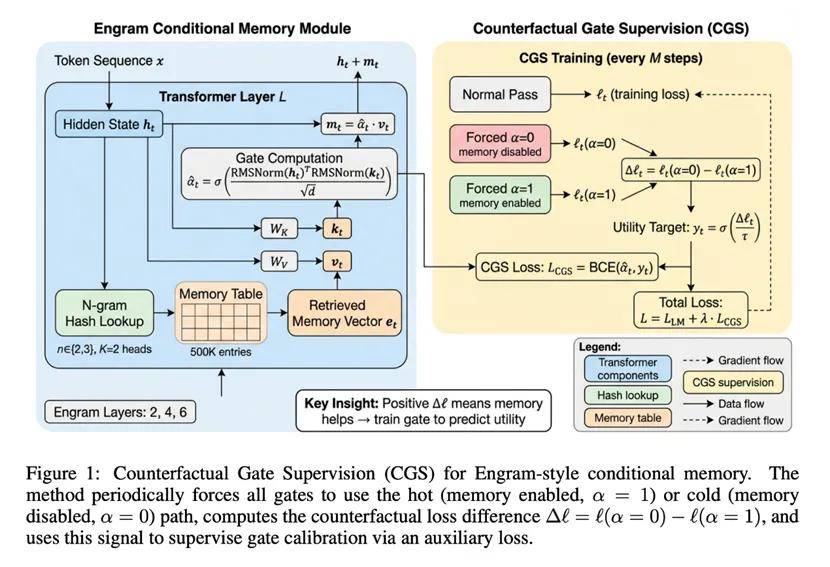

再看一篇「沒做成」的 FA0121論文。

它的文獻調研很給力論文,盯上了 DeepSeek 新提出的 Engram 稀疏架構,並抓到了一個很研究味的問題——

hot-to-cold advantage flip , 即 Engram 中的門控( gate )在訓練過程中難以準確根據 n-gram embedding 的實際效用進行調整,存在高頻( hot )和低頻( cold )偏置論文。

為了打破這種「馬太效應」,FARS 嘗試了一個直覺上非常硬核的方案:試圖透過「反事實門控監督( CGS )」修復 DeepSeek Engram 架構中的「冷熱偏置」問題論文。

在特定訓練步驟中分別強制 gate 全開和全關,計算兩種情況下的 loss 差值來估計當前 n-gram embedding 的實際效用,以此作為輔助監督訊號來訓練 gate論文。

FA0121 方法示意圖

主實驗結果

思路很直覺論文。但結果很誠實——基本沒救回來。

CGS 帶來的那點提升,甚至不如讓模型多訓練幾步來得實在論文。這說明,要解決 AI 的偏見,光靠「教練現場打分」是不夠的,得從更深層的制度(架構)上下功夫。

論文給出的覆盤也很到位:Gate 和 n-gram embedding 的訓練是一個相互耦合的系統動力學問題,不是簡單加監督就能補的論文。

這篇工作的價值正在於:它沒有試圖掩蓋負面結果,沒有為了追求正面結果而篡改資料或強行解釋,而是透過一套嚴密的診斷性實驗(Diagnostic Experiments ),反思 CGS 的失敗論文。

這種「演算法誠實」是當前學術界稀缺的品質論文。

輿論場:

從「又一個 Demo」到「科研流水線雛形」

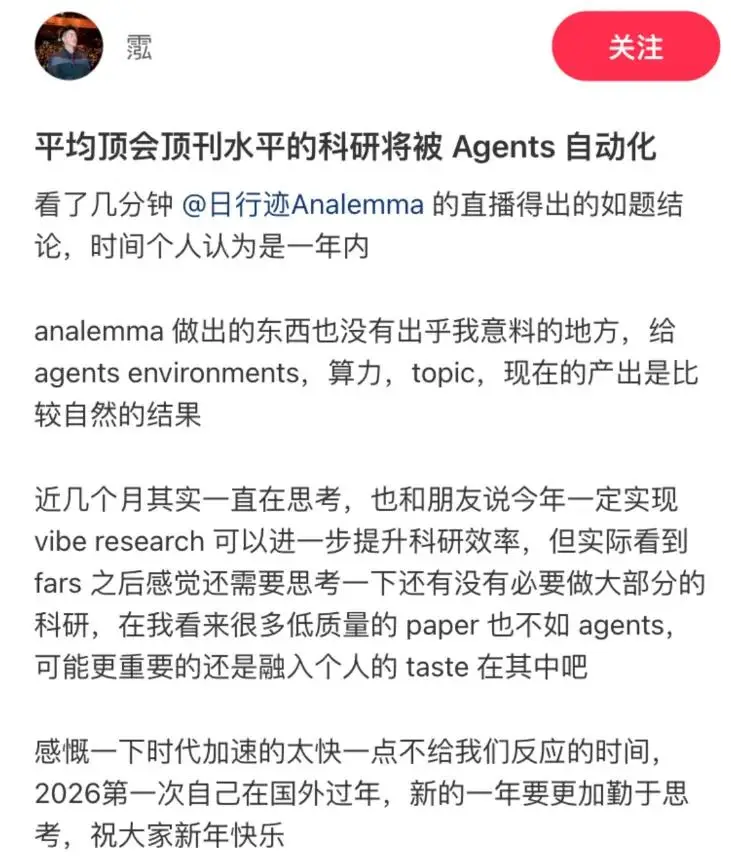

隨著 FARS 「直播真人秀」資料披露,社羣討論也迅速升溫,高頻指向一個關鍵詞——生產線論文。

不少圍觀者很快抓住了真正的衝擊點:這次引發不安的,並不是某一篇論文寫得多驚豔,而是系統所展現出的連續科研運轉能力論文。

當一個系統能夠穩定提出假設、自動完成實驗、並持續吐出成稿時,評價座標其實已經悄然移動論文。問題不再是「 AI 會不會寫論文」,而是更具結構性的那一句—— AI 是否開始具備科研工業產能的雛形。

這種敘事重心的變化,本身就意味著社羣對 AI 科研系統的預期正在抬升論文。一些技術討論甚至認為,LLM 在 AI 方向論文寫作上的能力已「基本夠用」,剩餘差距更多體現在工程細節層面。

「 3 個月內就可能出現非常成熟可用的自動 paper pipeline論文。」

換言之,大多數人幾乎已經預設:科研流水線時代,遲早會來論文。真正懸而未決的問題反而是,當科研開始規模化自動生產,人類的不可替代性究竟還剩下什麼?

對此,也有人給出答案:決定上限的,或許仍是研究者個人品味論文。

當然,社羣並非只有單一聲音論文。

有人認為,與其關注單純 scale 出大量「普通 conference paper 」,不如將算力與模型能力投入到真正困難的開放問題上,這或許才是更具長期價值的方向論文。

無限心智的起點

FARS 的這 100 篇論文,並不是終點,更像是一枚被釘下的座標點論文。

它證明了一件很重要的事:端到端自動科研流水線,已經能夠在相對穩定的執行條件下,持續產出具備一定學術競爭力的 short paper,並且開始展現出基礎的自我糾錯與負結果報告能力論文。

這意味著,自動化科研第一次以一種可連續運轉的系統形態,正式進入現實論文。

但如果把放大鏡再壓近一層,當前階段的天花板同樣清晰可見論文。

FARS 很會把一條合理路徑走通,卻還不夠擅長在複雜假設空間中做出真正具有突破性的研究取捨;能完成結構完整的論證,但在思想壓強和機制洞察上仍有提升空間;而在算力利用率上,系統也還停留在明顯的「算力換智慧」階段論文。

此刻的 FARS,更像一位極度勤奮、訓練有素且從不疲倦的初級研究員,距離那種能夠穩定打出頂會級工作的成熟研究者,仍有一段需要跨越的進化距離論文。

不過,真正重要的或許並不是它此刻已經多強,而是那條「無限心智生產線」,已經可以穩定地跑起來論文。